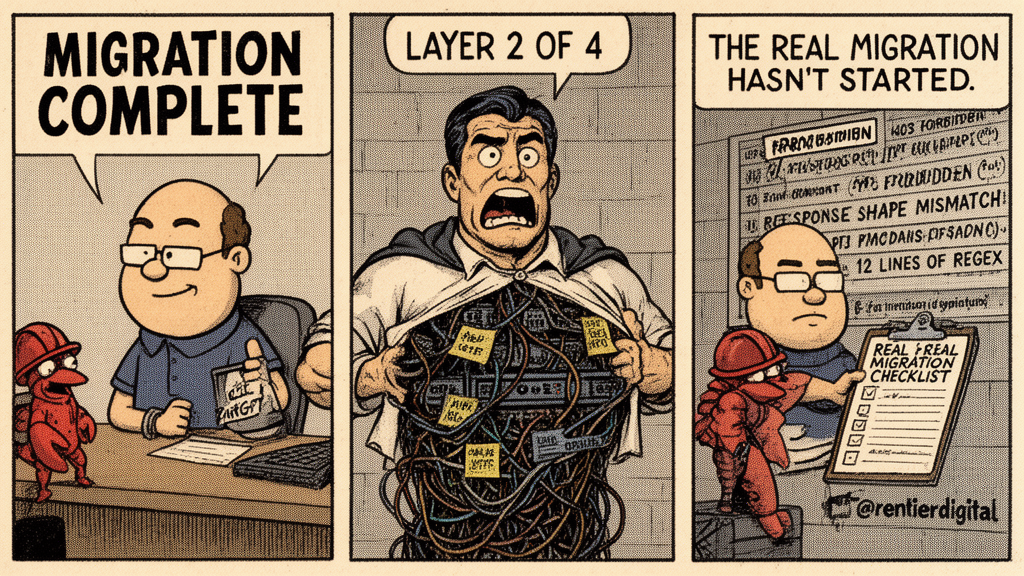

Le mouvement #QuitGPT atteint 1,5 million d'utilisateurs. La vraie migration n'a pas encore commencé.

L'outil Import Memory d'Anthropic migre vos préférences en 60 secondes. L'API Assistants d'OpenAI meurt en août. Une migration, c'est un hashtag. L'autre, c'est une réécriture complète.

Lundi matin, Claude plante. Tout. Le chatbot, l'API, Claude Code, absolument tout. Deux mille signalements sur Downdetector en moins d'une heure. Mon feed X, c'est un mur de gens qui ont quitté ChatGPT le week-end dernier et qui découvrent que leur tout nouveau fournisseur est déjà à plat ventre.

TL;DR : L'outil Import Memory d'Anthropic transfère vos préférences ChatGPT vers Claude en 60 secondes. Mais les préférences, ce n'est pas l'infrastructure. Quand Anthropic a tué mon setup d'agent à 200$/mois du jour au lendemain, aucun outil d'import ne m'a sauvé. J'ai reconstruit les serveurs MCP, les contrats de prompts, les wrappers CLI et le monitoring depuis zéro. Pendant ce temps, l'API Assistants d'OpenAI ferme en août, forçant des milliers de devs à tout réécrire, qu'ils rejoignent #QuitGPT ou pas. Cet article cartographie les 4 couches de verrouillage IA, montre ce qui migre vraiment vs ce qui ne migre pas, et vous donne un framework de portabilité pour ne plus jamais être coincé quand le prochain fournisseur décide de changer les règles.

J'ai ouvert mon terminal, tapé "anything broken" dans mon serveur MCP, obtenu mes réponses en quatre secondes. Cinq apps SaaS qui tournent. Les workflows n8n qui ronronnent. Aucune de mes infrastructures de prod ne se soucie que claude.ai passe une mauvaise journée.

Un million et demi de personnes ont promis de quitter ChatGPT la semaine dernière. Claude a atteint la #1 sur l'App Store, les téléchargements ont grimpé à 20 fois leurs niveaux de janvier, et les inscriptions quotidiennes ont battu le record absolu d'Anthropic chaque jour pendant une semaine entière. Et franchement, je comprends. Quand OpenAI a signé avec le Pentagone quelques heures après que Trump ait blacklisté Anthropic, ça m'a retourné l'estomac. Même sensation que quand Steinberger a rejoint OpenAI juste après avoir prêché que les modèles de frontière étaient la seule voie possible. Il y a des moments où on vote avec ses pieds, et c'est parfaitement respectable. Le mouvement #QuitGPT est légitime.

Mais voter avec ses pieds et migrer son infrastructure, ce ne sont pas les mêmes opérations. Anthropic a même livré un outil pour importer vos mémoires ChatGPT en 60 secondes. C'est malin. C'est bien fait. Et ça résout environ 2% du problème. Pendant ce temps, l'API Assistants d'OpenAI meurt le 26 août, et des milliers de devs avec des produits entiers qui tournent dessus n'ont pas eu droit à un bouton d'import. Ils ont eu droit à un compte à rebours.

Ce qu'Import Memory transfère vraiment (et ce qu'il ne transfère pas)

J'ai testé l'outil d'import. Ça a pris environ quatre-vingt-dix secondes. Vous allez dans les paramètres Claude, vous cliquez "Start import", Claude vous donne un prompt, vous le collez dans ChatGPT, ChatGPT déverse tout ce qu'il sait sur vous dans un bloc de code. Nom, boulot, préférences, sujets récurrents, le fait que vous détestez les listes à puces. Vous copiez, vous collez dans Claude, vous attendez 24 heures. Terminé. Claude reprend à peu près là où ChatGPT s'était arrêté.

Et pour quelqu'un qui utilise ChatGPT comme Google Maps — poser une question, obtenir une réponse, fermer l'onglet — c'est vraiment génial. Le coût de changement qui gardait les utilisateurs occasionnels prisonniers vient de s'évaporer. Anthropic l'a résolu en une semaine pendant que leur concurrent était occupé à signer des contrats de défense. Bien joué.

Mais j'ai ouvert le bloc exporté et regardé ce qui passait vraiment. Préférences de ton. Contexte personnel. Sujets que je discute souvent. Maintenant regardez ce qui n'est pas passé : mes prompts système personnalisés. Mes intégrations API. Mes configs de serveurs MCP. Mes wrappers CLI. Mes contrats de prompts. Mes workflows n8n qui référencent des comportements de modèles spécifiques. Mes tableaux de bord de monitoring câblés aux formes de réponse d'Anthropic. Argh.

Personne n'a de données d'usage sur combien de ces nouveaux utilisateurs ont vraiment lancé l'import. Tous les médias ont couvert l'annonce. Personne n'a mesuré l'adoption. Ce gap vous dit quelque chose sur le discours actuel : le narratif porte sur le geste, pas sur l'exécution.

Le geste est réel. L'exécution, c'est la couche 1 sur 4.

Il y a deux semaines, j'ai vécu la migration dont personne ne parle

Mon agent OpenClaw tournait sur Claude Max pendant six semaines. Emails, calendrier, Telegram, un système multi-modèles à travers cinq produits SaaS. Puis un matin, toutes les requêtes ont timeout. Pas d'email d'avertissement. Pas de période de grâce. Un mur de 403 et un vague avis de Conditions d'Utilisation.

Anthropic a décidé que faire passer un abonnement Max par autre chose que Claude Code était un motif de bannissement. Des milliers de devs l'ont découvert de la même façon que moi.

J'ai reconstruit. Deux instances VPS à 5$, Kimi K2.5 comme modèle principal, MiniMax M2.5 en fallback. La reconstruction complète de 200$ à 15$ a pris des jours, pas des minutes. Pas parce que les modèles étaient difficiles à échanger. Parce que l'infrastructure autour était soudée à un fournisseur spécifique.

Le truc que personne ne vous dit sur les migrations forcées : ce ne sont pas les gros morceaux qui bouffent votre temps. Ce sont les petits. J'avais un wrapper CLI qui parsait le format de réponse de Claude pour extraire les appels d'outils. Douze lignes de regex. Quand j'ai changé de modèles, la forme de réponse a changé, et ces douze lignes ont silencieusement cassé. Pas d'erreur — juste une sortie fausse qui avait l'air assez correcte pour passer un coup d'œil rapide. Je l'ai attrapé trois jours plus tard quand une alerte de monitoring a tiré sur des données qui n'avaient aucun sens. Trois jours de sortie subtilement corrompue à cause de douze lignes auxquelles personne ne pense jusqu'à ce qu'elles cassent.

Import Memory aurait sauvé environ 2% de cette migration. Les autres 98%, c'était l'infrastructure à laquelle personne ne pense jusqu'à ce qu'elle casse.

Le mécanisme : le verrouillage suit la stack

La migration #QuitGPT, c'est l'équivalent financier de déménager votre compte courant pendant que vos sociétés écrans restent enregistrées aux Caïmans. La partie visible bouge instantanément. La partie structurelle ne bouge pas du tout.

Ce n'est pas unique aux outils IA. C'est comme ça que fonctionne le verrouillage partout dans la tech. Migrer d'AWS vers GCP : les instances de calcul bougent, les politiques IAM et les intégrations spécifiques aux services prennent des mois. Passer de React à Vue : les composants UI se réécrivent, la gestion d'état et l'outillage de build prennent des semaines. Le pattern est toujours le même.

Plus l'intégration est profonde, plus le coût de changement est élevé.

Dans l'outillage IA, il y a quatre couches. Celle du haut est triviale à migrer. Chaque couche en dessous devient exponentiellement plus difficile. Et les 1,5 million de personnes qui ont promis de quitter ChatGPT ? Elles en ont résolu exactement une.

Les quatre couches de verrouillage IA

Couche 1 : Mémoire conversationnelle

Vos préférences, votre ton, votre contexte personnel. Le chatbot qui sait que vous aimez les réponses concises.

Tout migre. L'Import Memory d'Anthropic gère ça en 60 secondes, et ça marche. C'est la couche dont tout le monde parle, et c'est aussi la seule couche qui a une solution. Temps pour changer : minutes.

Couche 2 : Intégrations API

C'est là que ça arrête d'être un hashtag et que ça commence à être du travail d'ingénierie. Clés API, appels de modèles, SDK, facturation, limites de taux — le code qui connecte votre produit aux endpoints d'un fournisseur spécifique. Rien ne migre automatiquement. Vous échangez les clés, ajustez les paramètres, réécrivez les parties qui dépendent du comportement spécifique au fournisseur. Les modèles fine-tunés d'OpenAI ne tournent pas sur Anthropic. Les GPT personnalisés n'ont pas d'équivalent de l'autre côté.

Et c'est ce qui rend la deadline du 26 août urgente même si vous vous fichez complètement des contrats du Pentagone. L'API Assistants d'OpenAI ferme — dépréciée depuis août dernier, fermeture complète dans cinq mois. Chaque développeur qui a construit des produits dessus doit réécrire, qu'il se soucie ou non du discours QuitGPT. La seule question est de savoir s'ils réécrivent vers la nouvelle API Responses d'OpenAI ou utilisent la réécriture forcée comme une opportunité de changer complètement. Avouez-le, si vous avez du code sur cette API, vous repoussez cette décision depuis un moment.

Temps pour changer : heures à jours. Semaines si vous avez des modèles fine-tunés.

Couche 3 : Infrastructure d'agent

Le harnais. Serveurs MCP, contrats de prompts (votre CLAUDE.md ou prompts système), wrappers CLI, workflows n8n ou Make câblés à des modèles spécifiques, couches de mémoire, tâches cron, monitoring. L'échafaudage qui rend l'IA utile en production au lieu de juste dans une fenêtre de chat. Presque rien ne migre.

MCP est techniquement un protocole standard, et oui, OpenAI, Google et d'autres l'ont adopté. En théorie, un serveur MCP fonctionne avec n'importe quel fournisseur. En pratique, j'ai passé 16 commits et 4 heures à débugger OAuth pour l'implémentation MCP de Claude seule. Implémenter le même serveur pour un fournisseur différent signifie re-débugger un ensemble différent de contraintes non documentées. Même investissement en temps, zéro réutilisation.

La partie que les gens ratent constamment, ce sont les descriptions d'outils. Une description d'outil écrite pour le comportement de parsing de Claude ne performe pas de la même façon sur GPT ou Gemini. Le framework de contrats de prompts que j'utilise est calibré pour la façon dont Claude interprète la portée, les contraintes et la sortie attendue. Porter ça vers un autre modèle, ce n'est pas un chercher-remplacer. C'est re-tuner chaque contrat par essai-erreur. Pareil pour les harnais d'agents — la divulgation progressive, la structure CLAUDE.md, la logique de sélection d'outils, tout casse de façons subtiles qu'on ne découvre qu'en production.

Temps pour changer : jours à semaines.

Couche 4 : Connaissance institutionnelle

Tout ce que vous savez sur votre modèle qui n'est écrit nulle part.

Huit mois d'usage quotidien de Claude Code m'ont appris quelles formulations Claude traite comme des contraintes dures versus des suggestions molles. Quels formats d'instructions il suit versus lesquels il réinterprète créativement. Comment structurer un CLAUDE.md pour que le modèle le lise comme une couche de navigation au lieu de le survoler comme un README. Quand j'ai basculé ma stack d'agents vers Kimi K2.5 après l'arrêt d'Anthropic, les mêmes contrats de prompts ont produit des résultats différents. Pas faux — juste assez différents pour que je doive re-tuner chacun d'eux. Une contrainte que Claude interprétait comme "ne jamais faire X" a été lue comme "préférer ne pas faire X" par un modèle différent. Ce genre de dérive n'a pas jeté d'erreurs. Ça a juste silencieusement dégradé la sortie jusqu'à ce que quelque chose tire en monitoring qui n'avait aucun sens.

Aucune de cette connaissance ne se transfère. Il n'y a pas de bouton d'export pour l'intuition.

Import Memory transfère ce que le chatbot sait sur vous. Il ne transfère pas ce que vous savez sur le chatbot.

Temps pour changer : semaines à mois.

La foule QuitGPT a résolu la couche 1 en 60 secondes et a appelé ça une migration.

Construisez portable, ou construisez deux fois

Chaque couche a une défense. Voici comment découpler.

Pour la Couche 2, le move c'est d'abstraire vos appels de modèles. Ne hardcodez pas anthropic.messages.create ou openai.chat.completions.create dans chaque fichier — mettez une couche de routage entre. Je fais tourner Kimi K2.5 en principal avec MiniMax M2.5 en fallback, et le modèle est un paramètre, pas une constante. Quand Anthropic a tué mon setup, cette couche de routage c'est ce qui a fait que la reconstruction a pris des jours au lieu de semaines.

Pour la Couche 3, écrivez des contrats pour le comportement, pas pour un modèle. Au lieu de "Claude répond bien quand vous..." écrivez "L'agent doit produire la sortie X étant donné les contraintes Y avec la vérification Z." Le contrat décrit ce dont vous avez besoin, pas à quel modèle vous parlez. Vous devrez quand même tuner par modèle, mais le contrat survit à un swap de fournisseur — le tuning c'est un week-end, une réécriture de contrat depuis zéro c'est un mois. Gardez vos wrappers CLI agnostiques aux modèles aussi : stdin, stdout, le modèle comme variable d'environnement.

Pour la Couche 4, testez votre workflow sur deux modèles une fois par trimestre. Pas parce que vous prévoyez de changer. Parce que le test révèle quelles parties de votre setup sont portables et lesquelles sont soudées. Quand le fournisseur change les règles — et il le fera — vous saurez exactement où sont les soudures.

À travers tout ça : traitez chaque relation fournisseur comme temporaire. Ça sonne cynique. C'est ce que j'ai appris en me faisant fermer mon infrastructure par Anthropic pendant que je dormais. Ils ne me devaient pas d'avertissement. Je ne leur devais pas de loyauté permanente. Construisez en conséquence.

La meilleure stratégie de migration est celle dont vous n'avez jamais besoin.

Ce qui compte vraiment

Un million et demi de promesses. Dix-sept mille annulations vérifiées. Les téléchargements Claude à 20x leurs niveaux de janvier. Mais le truc avec les migrations de plateformes motivées par la protestation : elles sont bruyantes, elles sont rapides, et elles ne durent pas. Signal a eu 7,5 millions de téléchargements de protestation après la peur de la confidentialité WhatsApp en 2021. Les chercheurs n'ont jamais publié les données de rétention, ce qui vous dit tout sur les données de rétention. Quand les utilisateurs Twitter ont fui vers Mastodon en 2022, près de 80% sont restés actifs sur Twitter avec quatre fois l'engagement. Digg vers Reddit est la seule migration de protestation qui a tenu, et elle a tenu parce que Reddit était un meilleur produit, pas parce que les gens étaient plus en colère.

La fureur #QuitGPT va se calmer. Le classement App Store va se stabiliser. Le discours du Pentagone va passer au cycle suivant. Ce qui ne changera pas : si votre workflow dépend d'un chatbot web, vous êtes à la merci de chaque panne, chaque changement de prix, chaque changement de politique. Les devs qui n'ont pas remarqué la panne de lundi sont ceux dont l'infrastructure est découplée du fournisseur. Workflows qui tournent sur n8n. Monitoring à travers des serveurs MCP sur leur propre VPS. Routage de modèles qui se fiche de savoir quel fournisseur passe une mauvaise journée.

Le mouvement QuitGPT a posé la bonne question : devriez-vous faire confiance à une seule entreprise avec votre workflow IA ? La réponse est non. Mais pas pour les raisons que Reddit pense. Pas à cause des contrats du Pentagone. À cause du verrouillage. Parce que le fournisseur va toujours, éventuellement, changer les règles.

La vraie migration n'a pas commencé. Pour la plupart des gens, elle ne commencera jamais. Ceux qui construisent portable n'en auront pas besoin de toute façon.

Sources & liens :

- Outil Import Memory d'Anthropic

- Données de promesses QuitGPT (1,5M revendiquées, 17K vérifiées) : Cybernews, QuitGPT.org

- Surge de téléchargements Claude (20x niveaux janvier) : Similarweb via CNN (3 mars 2026)

- Claude #1 App Store, record d'inscriptions, +60% utilisateurs gratuits, 2x abonnés payants : TechCrunch / Sensor Tower (1er mars 2026)

- Désinstallations ChatGPT +295% : Sensor Tower via TechCrunch (2 mars 2026)

- Sunset API Assistants OpenAI : docs développeur OpenAI (annonce août 2025, fermeture complète 26 août 2026)

- Données téléchargements Signal : Sensor Tower via CNBC (janvier 2021)

- Étude migration Twitter/Mastodon : Jeong et al. 2023, arXiv

J'écris sur la construction d'infrastructure IA qui survit quand le fournisseur ne survit pas. Pas de hype, pas de hashtags, juste les trucs qui cassent et comment je les ai réparés. Suivez si c'est utile.

Cette image de couverture a été faite par IA. J'ai essayé d'embaucher un vrai illustrateur une fois mais il voulait "explorer la palette émotionnelle du verrouillage d'infrastructure" et j'avais juste besoin d'une image de serveur.