El Movimiento #QuitGPT Alcanzó 1.5 Millones de Usuarios. La Verdadera Migración Aún No Ha Comenzado.

La herramienta Import Memory de Anthropic migra tus preferencias en 60 segundos. La API Assistants de OpenAI muere en agosto. Una migración es un hashtag. La otra es reescribir todo.

Lunes por la mañana, Claude se cae. Todo. El chatbot, la API, Claude Code, todo. Dos mil reportes en Downdetector en menos de una hora. Mi feed de X es una pared de gente que se cambió de ChatGPT el fin de semana descubriendo que su flamante nuevo proveedor ya está patas arriba.

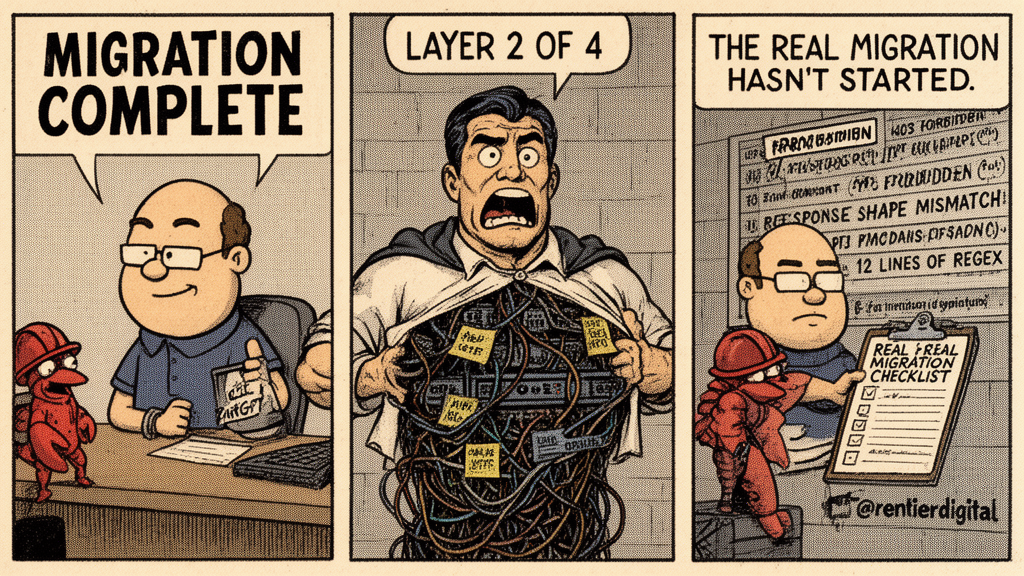

TL;DR: La herramienta Import Memory de Anthropic migra tus preferencias de ChatGPT a Claude en 60 segundos. Pero las preferencias no son infraestructura. Cuando Anthropic mató mi setup de agentes de $200/mes de la noche a la mañana, ninguna herramienta de importación me salvó. Reconstruí servidores MCP, contratos de prompts, wrappers CLI y monitoreo desde cero. Mientras tanto, la API Assistants de OpenAI se cierra en agosto, forzando a miles de devs a reescribir todo, se unan al #QuitGPT o no. Este artículo mapea las 4 capas del vendor lock-in de IA, muestra qué realmente migra vs. qué no, y te da un framework de portabilidad para que nunca quedes atrapado cuando el próximo proveedor decida cambiar las reglas.

Abrí mi terminal, escribí "anything broken" en mi servidor MCP, obtuve mis respuestas en cuatro segundos. Cinco apps SaaS funcionando. Workflows de n8n zumbando. A ninguna parte de mi infraestructura de producción le importa si claude.ai está teniendo un mal día.

Un millón y medio de personas prometieron abandonar ChatGPT la semana pasada. Claude llegó al #1 en el App Store, las descargas se dispararon a 20 veces sus niveles de enero, y los registros diarios rompieron el récord histórico de Anthropic todos los días durante una semana entera. Y honestamente, lo entiendo. Cuando OpenAI firmó con el Pentágono horas después de que Trump pusiera a Anthropic en la lista negra, me revolvió el estómago. La misma sensación que tuve cuando Steinberger se unió a OpenAI justo después de predicar que los modelos de frontera eran el único camino hacia adelante. Hay momentos en que votas con los pies, y eso está perfectamente bien. El movimiento #QuitGPT es respetable.

Pero votar con los pies y migrar tu infraestructura no son la misma operación. Anthropic incluso lanzó una herramienta para importar tus memorias de ChatGPT en 60 segundos. Es inteligente. Está bien hecha. Y resuelve aproximadamente el 2% del problema. Mientras tanto, la API Assistants de OpenAI muere el 26 de agosto, y miles de devs con productos enteros corriendo sobre ella no han recibido un botón de importación. Han recibido una cuenta regresiva.

Qué Migra Import Memory Realmente (Y Qué No)

Probé la herramienta de importación. Tomó unos noventa segundos. Vas a configuración de Claude, presionas "Start import," Claude te da un prompt, lo pegas en ChatGPT, ChatGPT vuelca todo lo que sabe sobre ti en un bloque de código. Nombre, trabajo, preferencias, temas recurrentes, el hecho de que odias las viñetas. Lo copias, lo pegas en Claude, esperas 24 horas. Listo. Claude continúa más o menos donde ChatGPT lo dejó.

Y para alguien que usa ChatGPT como usas Google Maps — hacer una pregunta, obtener una respuesta, cerrar la pestaña — esto es genuinamente genial. El costo de cambio que mantenía a los usuarios casuales atrapados acaba de evaporarse. Anthropic lo resolvió en una semana mientras su competidor estaba ocupado firmando contratos de defensa. Bien jugado.

Pero abrí el bloque exportado y miré qué realmente pasó. Preferencias de tono. Contexto personal. Temas que discuto frecuentemente. Ahora mira qué no pasó: mis prompts de sistema personalizados. Mis integraciones de API. Mis configuraciones de servidor MCP. Mis wrappers CLI. Mis contratos de prompts. Mis workflows de n8n que referencian comportamientos específicos de modelos. Mis dashboards de monitoreo conectados a las formas de respuesta de Anthropic. Ugh.

Nadie tiene datos de uso sobre cuántos de esos nuevos usuarios realmente ejecutaron la importación. Todos los medios cubrieron el anuncio. Nadie midió la adopción. Esa brecha te dice algo sobre el discurso actual: la narrativa es sobre el gesto, no la ejecución.

El gesto es real. La ejecución es la capa 1 de 4.

Hace Dos Semanas, Viví la Migración de la Que Nadie Habla

Mi agente OpenClaw corrió en Claude Max durante seis semanas. Emails, calendario, Telegram, un sistema multi-modelo a través de cinco productos SaaS. Entonces una mañana, cada request se agotó. Sin email de advertencia. Sin período de gracia. Una pared de 403s y un aviso vago de Términos de Servicio.

Anthropic decidió que canalizar una suscripción Max a través de cualquier cosa que no fuera Claude Code era una ofensa baneable. Miles de devs se enteraron de la misma manera que yo.

Reconstruí. Dos instancias VPS de $5, Kimi K2.5 como modelo primario, MiniMax M2.5 como respaldo. La reconstrucción completa de $200 a $15 tomó días, no minutos. No porque los modelos fueran difíciles de intercambiar. Porque la infraestructura alrededor de ellos estaba soldada a un proveedor específico.

Lo que nadie te dice sobre las migraciones forzadas: no son las piezas grandes las que se comen tu tiempo. Son las pequeñas. Tenía un wrapper CLI que parseaba el formato de respuesta de Claude para extraer llamadas de herramientas. Doce líneas de regex. Cuando cambié modelos, la forma de respuesta cambió, y esas doce líneas se rompieron silenciosamente. Sin error — solo output incorrecto que se veía lo suficientemente bien como para pasar un vistazo rápido. Lo detecté tres días después cuando una alerta de monitoreo se disparó con datos que no tenían sentido. Tres días de output sutilmente corrupto por doce líneas en las que nadie piensa.

Import Memory habría salvado aproximadamente el 2% de esa migración. El otro 98% era infraestructura en la que nadie piensa hasta que se rompe.

El Mecanismo: El Lock-In Sigue al Stack

La migración #QuitGPT es el equivalente financiero de mover tu cuenta corriente mientras tus empresas fantasma siguen registradas en las Caimán. La parte visible se mueve instantáneamente. La parte estructural no se mueve en absoluto.

Esto no es único de las herramientas de IA. Es como funciona el lock-in en todas partes en tech. Migrar de AWS a GCP: las instancias de cómputo se mueven, las políticas IAM y las integraciones específicas de servicio toman meses. Cambiar de React a Vue: los componentes UI se reescriben, el manejo de estado y las herramientas de build toman semanas. El patrón es siempre el mismo.

Mientras más profunda la integración, mayor el costo de cambio.

En herramientas de IA, hay cuatro capas. La de arriba es trivial de migrar. Cada capa debajo se vuelve exponencialmente más difícil. ¿Y el millón y medio de personas que prometieron abandonar ChatGPT? Resolvieron exactamente una de ellas.

Las Cuatro Capas del Lock-In de IA

Capa 1: Memoria conversacional

Tus preferencias, tu tono, tu contexto personal. El chatbot sabiendo que te gustan las respuestas concisas.

Todo migra. Import Memory de Anthropic maneja esto en 60 segundos, y funciona. Esta es la capa de la que todos hablan, y también es la única capa que tiene una solución. Tiempo para cambiar: minutos.

Capa 2: Integraciones API

Aquí es donde deja de ser un hashtag y empieza a ser trabajo de ingeniería. API keys, llamadas de modelo, SDKs, facturación, rate limits — el código que conecta tu producto a los endpoints de un proveedor específico. Nada de esto migra automáticamente. Intercambias keys, ajustas parámetros, reescribes las partes que dependen del comportamiento específico del proveedor. Los modelos fine-tuned de OpenAI no corren en Anthropic. Los GPTs personalizados no tienen equivalente del otro lado.

Y esto es lo que hace urgente la fecha límite del 26 de agosto incluso si no te importan los contratos del Pentágono en absoluto. La API Assistants de OpenAI se está cerrando — deprecada desde agosto pasado, cierre completo en cinco meses. Cada desarrollador que construyó productos sobre ella tiene que reescribir sin importar dónde esté parado en el discurso QuitGPT. La única pregunta es si reescriben hacia la nueva API Responses de OpenAI o usan la reescritura forzada como una oportunidad para cambiar completamente. Admítelo, si tienes código en esa API, has estado posponiendo esta decisión.

Tiempo para cambiar: horas a días. Semanas si tienes modelos fine-tuned.

Capa 3: Infraestructura de agentes

El harness. Servidores MCP, contratos de prompts (tu CLAUDE.md o prompts de sistema), wrappers CLI, workflows de n8n o Make conectados a modelos específicos, capas de memoria, cron jobs, monitoreo. El andamiaje que hace que la IA sea útil en producción en lugar de solo en una ventana de chat. Casi nada de esto migra.

MCP es técnicamente un protocolo estándar, y sí, OpenAI, Google y otros lo han adoptado. En teoría, un servidor MCP funciona con cualquier proveedor. En práctica, gasté 16 commits y 4 horas debuggeando OAuth solo para la implementación MCP de Claude. Implementar el mismo servidor para un proveedor diferente significa re-debuggear un conjunto diferente de restricciones no documentadas. La misma inversión de tiempo, cero reutilización.

La parte que la gente consistentemente pasa por alto son las descripciones de herramientas. Una descripción de herramienta escrita para el comportamiento de parsing de Claude no funciona de la misma manera en GPT o Gemini. El framework de contratos de prompts que uso está calibrado para cómo Claude interpreta alcance, restricciones y output esperado. Portar eso a otro modelo no es un buscar-y-reemplazar. Es re-afinar cada contrato a través de prueba y error. Lo mismo para harnesses de agentes — la divulgación progresiva, la estructura CLAUDE.md, la lógica de selección de herramientas todo se rompe de maneras sutiles que solo descubres en producción.

Tiempo para cambiar: días a semanas.

Capa 4: Conocimiento institucional

Todo lo que sabes sobre tu modelo que no está escrito en ningún lado.

Ocho meses de uso diario de Claude Code me enseñaron qué fraseos Claude trata como restricciones duras versus sugerencias suaves. Qué formatos de instrucción sigue versus cuáles reinterpreta creativamente. Cómo estructurar un CLAUDE.md para que el modelo lo lea como una capa de navegación en lugar de hojearlo como un README. Cuando cambié mi stack de agentes a Kimi K2.5 después del cierre de Anthropic, los mismos contratos de prompts produjeron resultados diferentes. No incorrectos — solo lo suficientemente diferentes como para que tuviera que re-afinar cada uno de ellos. Una restricción que Claude interpretaba como "nunca hagas X" fue leída como "prefiere no hacer X" por un modelo diferente. Ese tipo de deriva no arrojó errores. Solo degradó silenciosamente el output hasta que algo se disparó en el monitoreo que no tenía sentido.

Nada de ese conocimiento se transfiere. No hay botón de exportación para la intuición.

Import Memory transfiere lo que el chatbot sabe sobre ti. No transfiere lo que tú sabes sobre el chatbot.

Tiempo para cambiar: semanas a meses.

La multitud QuitGPT resolvió la capa 1 en 60 segundos y lo llamó una migración.

Construye Portable, O Construye Dos Veces

Cada capa tiene una defensa. Así es como desacoplar.

Para la Capa 2, el movimiento es abstraer tus llamadas de modelo. No hardcodees anthropic.messages.create o openai.chat.completions.create en cada archivo — pon una capa de routing en el medio. Corro Kimi K2.5 como primario con MiniMax M2.5 como respaldo, y el modelo es un parámetro, no una constante. Cuando Anthropic mató mi setup, esa capa de routing es lo que hizo que la reconstrucción tomara días en lugar de semanas.

Para la Capa 3, escribe contratos para comportamiento, no para un modelo. En lugar de "Claude responde bien cuando..." escribe "El agente debe producir output X dado restricciones Y con verificación Z." El contrato describe lo que necesitas, no a qué modelo le estás hablando. Aún afinarás por modelo, pero el contrato sobrevive un cambio de proveedor — el afinado es un fin de semana, una reescritura de contrato desde cero es un mes. Mantén tus wrappers CLI model-agnostic también: stdin, stdout, el modelo como una variable de entorno.

Para la Capa 4, prueba tu workflow en dos modelos una vez por trimestre. No porque estés planeando cambiar. Porque la prueba revela qué partes de tu setup son portables y cuáles están soldadas. Cuando el proveedor cambie las reglas — y lo harán — sabrás exactamente dónde están las soldaduras.

A través de todo: trata cada relación de proveedor como temporal. Esto suena cínico. Es lo que aprendí de que Anthropic cerrara mi infraestructura mientras dormía. No me debían una advertencia. Yo no les debía lealtad permanente. Construye en consecuencia.

La mejor estrategia de migración es la que nunca necesitas.

Lo Que Realmente Importa

Un millón y medio de promesas. Diecisiete mil cancelaciones verificadas. Descargas de Claude a 20x sus niveles de enero. Pero lo que pasa con las migraciones de plataforma impulsadas por protesta: son ruidosas, son rápidas, y no duran. Signal obtuvo 7.5 millones de descargas de protesta después del susto de privacidad de WhatsApp en 2021. Los investigadores nunca publicaron los datos de retención, lo que te dice todo sobre los datos de retención. Cuando los usuarios de Twitter huyeron a Mastodon en 2022, casi el 80% se mantuvo activo en Twitter con cuatro veces el engagement. Digg a Reddit es la única migración de protesta que se mantuvo, y se mantuvo porque Reddit era un mejor producto, no porque la gente estuviera más enojada.

La furia #QuitGPT se enfriará. El ranking del App Store se asentará. El discurso del Pentágono se moverá al siguiente ciclo. Lo que no cambiará: si tu workflow depende de un chatbot web, estás a merced de cada caída, cada cambio de precio, cada cambio de política. Los devs que no notaron la caída del lunes son los que tienen su infraestructura desacoplada del proveedor. Workflows corriendo en n8n. Monitoreo a través de servidores MCP en su propio VPS. Routing de modelos que no le importa qué proveedor está teniendo un mal día.

El movimiento QuitGPT hizo la pregunta correcta: ¿deberías confiar en una sola empresa con tu workflow de IA? La respuesta es no. Pero no por las razones que Reddit piensa. No por los contratos del Pentágono. Por el lock-in. Porque el proveedor siempre, eventualmente, cambiará las reglas.

La migración real no ha comenzado. Para la mayoría de la gente, nunca lo hará. Los que construyen portable no la necesitarán de todos modos.

Fuentes y enlaces:

- Herramienta Import Memory de Anthropic

- Datos de promesa QuitGPT (1.5M reclamados, 17K verificados): Cybernews, QuitGPT.org

- Aumento de descargas de Claude (20x niveles de enero): Similarweb vía CNN (3 de marzo, 2026)

- Claude #1 App Store, récord de registros, +60% usuarios gratuitos, 2x subs pagadas: TechCrunch / Sensor Tower (1 de marzo, 2026)

- Desinstalaciones de ChatGPT +295%: Sensor Tower vía TechCrunch (2 de marzo, 2026)

- Cierre de API Assistants de OpenAI: docs de desarrollador de OpenAI (anuncio agosto 2025, cierre completo 26 de agosto, 2026)

- Datos de descarga de Signal: Sensor Tower vía CNBC (enero 2021)

- Estudio de migración Twitter/Mastodon: Jeong et al. 2023, arXiv

Escribo sobre construir infraestructura de IA que sobrevive cuando el proveedor no. Sin hype, sin hashtags, solo las cosas que se rompen y cómo las arreglé. Sígueme si eso te es útil.

Esa imagen de portada fue hecha por IA. Una vez traté de contratar un ilustrador real pero querían "explorar la paleta emocional del lock-in de infraestructura" y yo solo necesitaba una imagen de un servidor.