Die #QuitGPT-Bewegung erreichte 1,5 Millionen Nutzer. Die echte Migration hat noch nicht begonnen.

Anthropics Import Memory Tool überträgt deine Einstellungen in 60 Sekunden. OpenAIs Assistants API stirbt im August. Die eine Migration ist ein Hashtag. Die andere ein kompletter Neuaufbau.

Montagmorgen, Claude geht down. Alles. Der Chatbot, die API, Claude Code, komplett tot. Zweitausend Meldungen auf Downdetector in unter einer Stunde. Mein X-Feed ist eine Wand aus Leuten, die am Wochenende von ChatGPT gewechselt sind und jetzt entdecken, dass ihr brandneuer Anbieter bereits flach auf dem Rücken liegt.

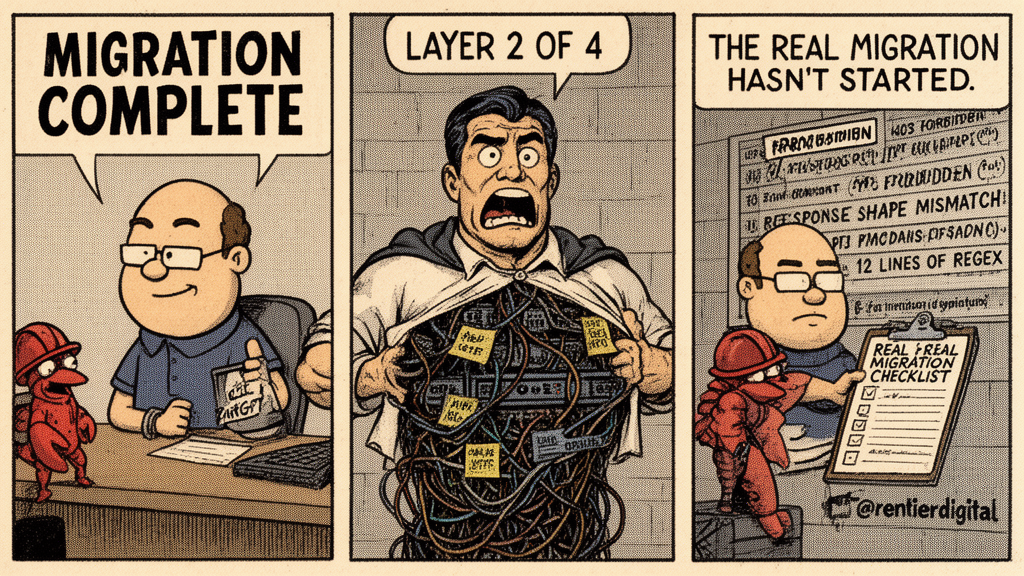

TL;DR: Anthropics Import Memory Tool überträgt deine ChatGPT-Einstellungen in 60 Sekunden zu Claude. Aber Einstellungen sind keine Infrastruktur. Als Anthropic mein 200€/Monat Agent-Setup über Nacht killte, hat mich kein Import-Tool gerettet. Ich musste MCP-Server, Prompt-Verträge, CLI-Wrapper und Monitoring komplett neu aufbauen. Währenddessen wird OpenAIs Assistants API im August eingestellt und zwingt tausende Entwickler zum Neuschreiben – egal ob sie bei #QuitGPT mitmachen oder nicht. Dieser Artikel zeigt die 4 Ebenen des AI-Lock-ins, was tatsächlich migriert vs. was nicht, und gibt dir ein Portabilitäts-Framework, damit du nie wieder feststeckst, wenn der nächste Anbieter die Regeln ändert.

Ich öffnete mein Terminal, tippte "anything broken" in meinen MCP-Server, hatte meine Antworten in vier Sekunden. Fünf SaaS-Apps laufen. n8n-Workflows summen vor sich hin. Meine Produktions-Infrastruktur interessiert es einen Dreck, ob claude.ai einen schlechten Tag hat.

Eineinhalb Millionen Menschen schworen letzte Woche, ChatGPT zu verlassen. Claude erreichte Platz 1 im App Store, Downloads schossen auf das 20-fache der Januar-Zahlen, und tägliche Anmeldungen brachen eine Woche lang jeden Tag Anthropics Allzeit-Rekord. Und ehrlich, ich verstehe es. Als OpenAI Stunden nach Trumps Anthropic-Blacklist mit dem Pentagon unterschrieb, drehte sich mir der Magen um. Dasselbe Gefühl wie bei Steinbergers OpenAI-Wechsel, direkt nachdem er gepredigt hatte, dass Frontier-Models der einzige Weg nach vorn seien. Es gibt Momente, da stimmt man mit den Füßen ab, und das ist völlig in Ordnung. Die #QuitGPT-Bewegung ist respektabel.

Aber mit den Füßen abstimmen und Infrastruktur migrieren sind nicht dieselbe Operation. Anthropic lieferte sogar ein Tool, um ChatGPT-Memories in 60 Sekunden zu importieren. Es ist clever. Es ist gut gemacht. Und es löst etwa 2% des Problems. Währenddessen stirbt OpenAIs Assistants API am 26. August, und tausende Entwickler mit ganzen Produkten darauf haben keinen Import-Button bekommen. Sie haben einen Countdown bekommen.

Was Import Memory tatsächlich überträgt (und was nicht)

Ich probierte das Import-Tool aus. Dauerte etwa neunzig Sekunden. Du gehst in die Claude-Einstellungen, klickst "Import starten", Claude gibt dir einen Prompt, du fügst ihn in ChatGPT ein, ChatGPT spuckt alles aus, was es über dich weiß, in einen Code-Block. Name, Job, Präferenzen, wiederkehrende Themen, die Tatsache, dass du Bullet Points hasst. Du kopierst es, fügst es in Claude ein, wartest 24 Stunden. Fertig. Claude macht ungefähr da weiter, wo ChatGPT aufgehört hat.

Und für jemanden, der ChatGPT wie Google Maps nutzt – Frage stellen, Antwort bekommen, Tab schließen – ist das wirklich großartig. Die Wechselkosten, die Gelegenheitsnutzer eingesperrt hielten, sind einfach verdampft. Anthropic löste das in einer Woche, während ihr Konkurrent damit beschäftigt war, Verteidigungs-Verträge zu unterschreiben. Gut gespielt.

Aber ich öffnete den exportierten Block und schaute, was tatsächlich durchkam. Ton-Präferenzen. Persönlicher Kontext. Themen, die ich oft diskutiere. Jetzt schau, was nicht durchkam: meine benutzerdefinierten System-Prompts. Meine API-Integrationen. Meine MCP-Server-Configs. Meine CLI-Wrapper. Meine Prompt-Verträge. Meine n8n-Workflows, die auf spezifische Model-Verhaltensweisen referenzieren. Meine Monitoring-Dashboards, die auf Anthropics Response-Shapes verdrahtet sind. Ugh.

Niemand hat Nutzungsdaten darüber, wie viele dieser neuen Nutzer tatsächlich den Import durchführten. Jedes Outlet berichtete über die Ankündigung. Niemand maß die Adoption. Diese Lücke sagt etwas über den aktuellen Diskurs: die Erzählung dreht sich um die Geste, nicht um die Umsetzung.

Die Geste ist real. Die Umsetzung ist Ebene 1 von 4.

Vor zwei Wochen erlebte ich die Migration, über die niemand spricht

Mein OpenClaw-Agent lief sechs Wochen auf Claude Max. E-Mails, Kalender, Telegram, ein Multi-Model-System über fünf SaaS-Produkte. Dann eines Morgens timeoutete jede Anfrage. Keine Warn-E-Mail. Keine Gnadenfrist. Eine Wand aus 403ern und ein vager Terms-of-Service-Hinweis.

Anthropic entschied, dass das Durchleiten eines Max-Abonnements durch alles, was nicht Claude Code ist, ein Bann-Grund war. Tausende Entwickler fanden es genauso heraus wie ich.

Ich baute neu auf. Zwei 5€-VPS-Instanzen, Kimi K2.5 als primäres Model, MiniMax M2.5 als Fallback. Der komplette Neuaufbau von 200€ auf 15€ dauerte Tage, nicht Minuten. Nicht weil die Models schwer zu tauschen waren. Weil die Infrastruktur drumherum an einen spezifischen Anbieter geschweißt war.

Was dir niemand über erzwungene Migrationen erzählt: Es sind nicht die großen Teile, die deine Zeit fressen. Es sind die kleinen. Ich hatte einen CLI-Wrapper, der Claudes Response-Format parste, um Tool-Calls zu extrahieren. Zwölf Zeilen Regex. Als ich Models wechselte, änderte sich die Response-Shape, und diese zwölf Zeilen brachen stillschweigend. Kein Fehler – nur falscher Output, der richtig genug aussah, um einen schnellen Blick zu überstehen. Ich erwischte es drei Tage später, als ein Monitoring-Alert bei Daten feuerte, die keinen Sinn ergaben. Drei Tage subtil korrupter Output wegen zwölf Zeilen, an die niemand denkt.

Import Memory hätte etwa 2% dieser Migration gerettet. Die anderen 98% waren Infrastruktur, an die niemand denkt, bis sie bricht.

Der Mechanismus: Lock-In folgt dem Stack

Die #QuitGPT-Migration ist das finanzielle Äquivalent dazu, dein Girokonto zu wechseln, während deine Briefkastenfirmen auf den Caymans registriert bleiben. Der sichtbare Teil bewegt sich sofort. Der strukturelle Teil bewegt sich gar nicht.

Das ist nicht einzigartig für AI-Tools. So funktioniert Lock-In überall in der Tech. Migration von AWS zu GCP: die Compute-Instanzen ziehen um, die IAM-Policies und service-spezifischen Integrationen dauern Monate. Wechsel von React zu Vue: die UI-Komponenten werden neu geschrieben, State-Management und Build-Tooling dauern Wochen. Das Muster ist immer dasselbe.

Je tiefer die Integration, desto höher die Wechselkosten.

Bei AI-Tooling gibt es vier Ebenen. Die oberste ist trivial zu migrieren. Jede Ebene darunter wird exponentiell schwerer. Und die 1,5 Millionen Menschen, die schworen, ChatGPT zu verlassen? Sie lösten genau eine davon.

Die vier Ebenen des AI-Lock-ins

Ebene 1: Konversations-Gedächtnis

Deine Präferenzen, dein Ton, dein persönlicher Kontext. Dass der Chatbot weiß, dass du knappe Antworten magst.

Alles migriert. Anthropics Import Memory erledigt das in 60 Sekunden, und es funktioniert. Das ist die Ebene, über die alle reden, und es ist auch die einzige Ebene, die eine Lösung hat. Zeit zum Wechseln: Minuten.

Ebene 2: API-Integrationen

Hier hört es auf, ein Hashtag zu sein, und wird zu Engineering-Arbeit. API-Keys, Model-Calls, SDKs, Billing, Rate-Limits – der Code, der dein Produkt mit den Endpoints eines spezifischen Anbieters verbindet. Nichts davon migriert automatisch. Du tauschst Keys, justierst Parameter, schreibst die Teile neu, die von anbieter-spezifischem Verhalten abhängen. Fine-getunte OpenAI-Models laufen nicht auf Anthropic. Custom GPTs haben kein Äquivalent auf der anderen Seite.

Und das macht die 26. August-Deadline dringend, selbst wenn dir Pentagon-Verträge völlig egal sind. OpenAIs Assistants API wird eingestellt – deprecated seit letztem August, komplette Abschaltung in fünf Monaten. Jeder Entwickler, der Produkte darauf gebaut hat, muss neu schreiben, egal wo er zum QuitGPT-Diskurs steht. Die einzige Frage ist, ob sie zur neuen Responses API von OpenAI neu schreiben oder das erzwungene Rewrite als Gelegenheit nutzen, komplett zu wechseln. Gib's zu, wenn du Code auf dieser API hast, schiebst du diese Entscheidung schon eine Weile vor dir her.

Zeit zum Wechseln: Stunden bis Tage. Wochen, wenn du fine-getunte Models hast.

Ebene 3: Agent-Infrastruktur

Das Geschirr. MCP-Server, Prompt-Verträge (deine CLAUDE.md oder System-Prompts), CLI-Wrapper, n8n- oder Make-Workflows, die auf spezifische Models verdrahtet sind, Memory-Layer, Cron-Jobs, Monitoring. Das Gerüst, das AI in der Produktion nützlich macht statt nur in einem Chat-Fenster. Fast nichts davon migriert.

MCP ist technisch ein Standard-Protokoll, und ja, OpenAI, Google und andere haben es adoptiert. Theoretisch funktioniert ein MCP-Server mit jedem Anbieter. Praktisch verbrachte ich 16 Commits und 4 Stunden mit OAuth-Debugging allein für Claudes MCP-Implementation. Denselben Server für einen anderen Anbieter zu implementieren bedeutet, einen anderen Satz undokumentierter Constraints neu zu debuggen. Gleicher Zeitaufwand, null Wiederverwendung.

Der Teil, den Leute konstant übersehen, sind die Tool-Beschreibungen. Eine Tool-Beschreibung, die für Claudes Parsing-Verhalten geschrieben wurde, performt nicht gleich auf GPT oder Gemini. Das Prompt-Contracts-Framework, das ich nutze, ist darauf kalibriert, wie Claude Scope, Constraints und erwarteten Output interpretiert. Das auf ein anderes Model zu portieren ist kein Find-and-Replace. Es ist Re-Tuning jedes Vertrags durch Trial-and-Error. Dasselbe für Agent-Harnesses – die progressive Disclosure, die CLAUDE.md-Struktur, die Tool-Selection-Logik brechen alle auf subtile Weise, die du erst in der Produktion entdeckst.

Zeit zum Wechseln: Tage bis Wochen.

Ebene 4: Institutionelles Wissen

Alles, was du über dein Model weißt, das nirgendwo aufgeschrieben steht.

Acht Monate täglicher Claude Code-Nutzung lehrten mich, welche Formulierungen Claude als harte Constraints versus weiche Vorschläge behandelt. Welche Instruction-Formate es befolgt versus welche es kreativ reinterpretiert. Wie man eine CLAUDE.md strukturiert, damit das Model sie als Navigation-Layer liest statt sie wie eine README zu überfliegen. Als ich mein Agent-Stack nach der Anthropic-Abschaltung auf Kimi K2.5 umstellte, produzierten dieselben Prompt-Verträge andere Ergebnisse. Nicht falsch – nur anders genug, dass ich jeden einzelnen neu tunen musste. Ein Constraint, das Claude als "mach niemals X" interpretierte, wurde als "mach lieber nicht X" von einem anderen Model gelesen. Diese Art Drift warf keine Fehler. Sie degradierte nur stillschweigend den Output, bis etwas im Monitoring feuerte, das keinen Sinn ergab.

Nichts von diesem Wissen überträgt sich. Es gibt keinen Export-Button für Intuition.

Import Memory überträgt, was der Chatbot über dich weiß. Es überträgt nicht, was du über den Chatbot weißt.

Zeit zum Wechseln: Wochen bis Monate.

Die QuitGPT-Crowd löste Ebene 1 in 60 Sekunden und nannte es Migration.

Bau portabel, oder bau zweimal

Jede Ebene hat eine Verteidigung. So entkoppelst du.

Für Ebene 2 ist der Move, deine Model-Calls zu abstrahieren. Hardcode nicht anthropic.messages.create oder openai.chat.completions.create in jede Datei – leg eine Routing-Ebene dazwischen. Ich laufe mit Kimi K2.5 als Primary mit MiniMax M2.5 als Fallback, und das Model ist ein Parameter, keine Konstante. Als Anthropic mein Setup killte, war diese Routing-Ebene der Grund, warum der Neuaufbau Tage statt Wochen dauerte.

Für Ebene 3, schreib Verträge für Verhalten, nicht für ein Model. Statt "Claude antwortet gut, wenn du..." schreib "Der Agent muss X Output bei Y Constraints mit Z Verifikation produzieren." Der Vertrag beschreibt, was du brauchst, nicht mit welchem Model du redest. Du wirst trotzdem pro Model tunen, aber der Vertrag überlebt einen Provider-Swap – das Tuning ist ein Wochenende, ein Vertrag-Rewrite von Grund auf ist ein Monat. Halt deine CLI-Wrapper model-agnostisch auch: stdin, stdout, das Model als Environment-Variable.

Für Ebene 4, teste deinen Workflow einmal im Quartal auf zwei Models. Nicht weil du planst zu wechseln. Weil der Test zeigt, welche Teile deines Setups portabel sind und welche geschweißt. Wenn der Provider die Regeln ändert – und das werden sie – weißt du genau, wo die Schweißnähte sind.

Über alles hinweg: behandle jede Provider-Beziehung als temporär. Das klingt zynisch. Es ist, was ich lernte, als Anthropic meine Infrastruktur abschaltete, während ich schlief. Sie schuldeten mir keine Warnung. Ich schuldete ihnen keine permanente Loyalität. Bau entsprechend.

Die beste Migrations-Strategie ist die, die du nie brauchst.

Was wirklich zählt

Eineinhalb Millionen Schwüre. Siebzehntausend verifizierte Kündigungen. Claude-Downloads auf dem 20-fachen ihrer Januar-Level. Aber die Sache mit protest-getriebenen Plattform-Migrationen: sie sind laut, sie sind schnell, und sie halten nicht. Signal bekam 7,5 Millionen Protest-Downloads nach dem WhatsApp-Privacy-Schreck 2021. Forscher veröffentlichten nie die Retention-Daten, was dir alles über die Retention-Daten sagt. Als Twitter-Nutzer 2022 zu Mastodon flohen, blieben fast 80% auf Twitter aktiv mit viermal dem Engagement. Digg zu Reddit ist die einzige Protest-Migration, die hielt, und sie hielt, weil Reddit ein besseres Produkt war, nicht weil die Leute wütender waren.

Die #QuitGPT-Wut wird abkühlen. Das App Store-Ranking wird sich setzen. Der Pentagon-Diskurs wird zum nächsten Zyklus wechseln. Was sich nicht ändern wird: wenn dein Workflow von einem Web-Chatbot abhängt, bist du der Gnade jedes Ausfalls, jeder Preisänderung, jeder Policy-Verschiebung ausgeliefert. Die Entwickler, die Montags Ausfall nicht bemerkten, sind die, deren Infrastruktur vom Provider entkoppelt ist. Workflows, die auf n8n laufen. Monitoring durch MCP-Server auf ihrem eigenen VPS. Model-Routing, das nicht interessiert, welcher Provider einen schlechten Tag hat.

Die QuitGPT-Bewegung stellte die richtige Frage: solltest du einer einzigen Firma deinen AI-Workflow anvertrauen? Die Antwort ist nein. Aber nicht aus den Gründen, die Reddit denkt. Nicht wegen Pentagon-Verträgen. Wegen Lock-in. Weil der Provider immer, irgendwann, die Regeln ändern wird.

Die echte Migration hat nicht begonnen. Für die meisten Leute wird sie es nie. Die, die portabel bauen, werden sie sowieso nicht brauchen.

Quellen & Links:

- Anthropic Import Memory tool

- QuitGPT pledge data (1.5M claimed, 17K verified): Cybernews, QuitGPT.org

- Claude download surge (20x January levels): Similarweb via CNN (March 3, 2026)

- Claude #1 App Store, signups record, +60% free users, 2x paid subs: TechCrunch / Sensor Tower (March 1, 2026)

- ChatGPT uninstalls +295%: Sensor Tower via TechCrunch (March 2, 2026)

- OpenAI Assistants API sunset: OpenAI developer docs (August 2025 announcement, full shutdown August 26, 2026)

- Signal download data: Sensor Tower via CNBC (January 2021)

- Twitter/Mastodon migration study: Jeong et al. 2023, arXiv

Ich schreibe über den Aufbau von AI-Infrastruktur, die überlebt, wenn der Provider nicht überlebt. Kein Hype, keine Hashtags, nur das Zeug, das bricht und wie ich es reparierte. Folgen, wenn das nützlich ist.

Das Cover-Bild wurde von AI gemacht. Ich versuchte mal, einen echten Illustrator zu beauftragen, aber der wollte "die emotionale Palette des Infrastruktur-Lock-ins erkunden" und ich brauchte nur ein Bild von einem Server.